Tesla решила проблему слепых зон автопилота с помощью невидимых «парящих» камер.

Tesla запатентовала систему «виртуальных камер», которая создаёт фантомные сенсоры с помощью математики и нейросетей. Вместо лидаров и радаров компания строит многослойное AI-зрение с temporal memory, 20-метровым «перископом» и цифровым 3D-пространством вокруг автомобиля.

Священный Грааль автономного вождения всегда заключался в том, чтобы идеально воспроизвести человеческую зрительную кору, а затем превзойти её. Пока конкуренты продолжают полагаться на сложную и подверженную ошибкам смесь лидаров и радаров, буквально «нащупывая» препятствия вокруг себя, Tesla разработала совершенно иной подход. Компания создала «фантомные сенсоры» с помощью чистой математики.

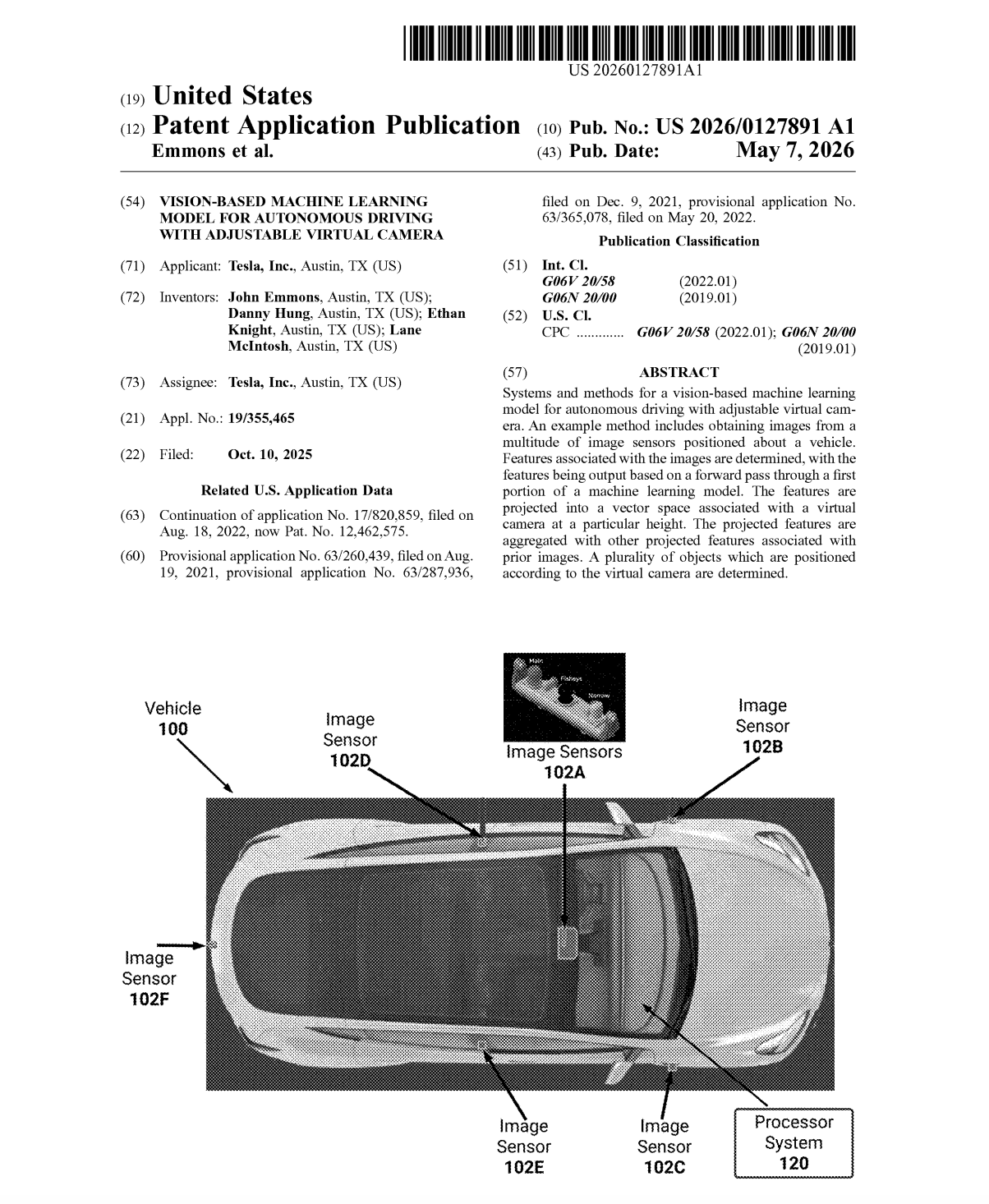

Это подробно и элегантно описано в патенте US 20260127891 A1, опубликованном 7 мая 2026 года. Документ фактически раскрывает фундаментальную архитектуру долгожданной системы Pure Vision, лежащей в основе современного автопарка Tesla.

Ключевой прорыв, описанный в патенте, — это гениальная регулируемая сеть виртуальных камер. Вместо того чтобы «сшивать» плоские изображения с восьми физических камер, бортовой компьютер буквально галлюцинирует единую идеальную векторную среду. Система динамически создаёт невидимые камеры, парящие вокруг автомобиля на разных высотах.

Это позволяет нейросети смотреть на дорогу сверху — как через перископ — для отслеживания быстро движущихся автомобилей, одновременно анализируя пешеходов на уровне глаз, чтобы предсказывать их следующий шаг. Это фундаментальный переход от зависимости от физических сенсоров к искусственному восприятию.

Проблема: ловушка аппаратного обеспечения и фрагментированное зрение

Индустрия автономного вождения застряла в гонке аппаратного вооружения. Конкуренты продолжают навешивать на машины всё более дорогие радары и лидары, надеясь, что больше сенсоров автоматически означает лучшее восприятие мира. Но этот brute force подход создаёт огромные инженерные ограничения.

Радары регулярно ошибочно интерпретируют отражённые сигналы и «галлюцинируют» препятствия, вызывая внезапное торможение. Лидары же легко ослепляются сильным дождём или густым туманом. Когда такие системы путаются, автомобиль отключает автопилот и требует немедленно вернуть управление человеку.

Даже ранние pure vision системы, полностью основанные на обычных камерах, как у человека, сталкивались с тупиком. Старое ПО пыталось неуклюже объединять видеопотоки, словно мозг, пытающийся склеить изображения сразу от восьми глаз.

Если грузовик перемещался из изображения боковой камеры в переднюю, инженерам приходилось вручную прописывать хрупкие правила, вместо того чтобы позволить ИИ самостоятельно понять структуру сцены.

Дополнительной проблемой был классический birds eye view — вид сверху, который превращает мир в плоскую двумерную карту.

Для разметки полос это работает отлично, но пешеход сверху превращается в маленькую точку. Исчезают критически важные детали: поза, направление взгляда, язык тела. Система перестаёт понимать, собирается ли ребёнок внезапно выбежать на дорогу.

Решение Tesla: две независимые виртуальные перспективы

Чтобы выйти из этой аппаратной ловушки, Tesla разработала pure vision ML-модель с регулируемыми виртуальными камерами. Вместо ручного объединения видеопотоков система одновременно получает данные со всех восьми камер. Нейросети извлекают ключевые признаки изображения: контуры объектов, формы, траектории движения.

Затем всё это математически проецируется в единую трёхмерную векторную среду, где каждый объект получает точные координаты. Это полностью устраняет слепые зоны между камерами. Но главный гений патента — в решении проблемы top-down перспективы.

Нейросеть разделяется на две специализированные ветки:

— одна полностью сосредоточена на уязвимых участниках движения: пешеходах, велосипедистах, людях на скейтбордах;

— вторая специализируется на автомобилях и грузовиках.

Вместо того чтобы помещать всё в одну плоскую карту, каждая ветка создаёт собственное виртуальное пространство камеры.

HDR и интеллектуальная экспозиция

Перед построением виртуального пространства система агрессивно оптимизирует изображение. Каждая из восьми камер делает несколько снимков одновременно с разными уровнями экспозиции. Это достигается разными integration times — фактически разной «выдержкой» сенсора.

Затем процессор объединяет изображения в единый HDR-кадр, выбирая только те пиксели, где нет пересветов и провалов в тени. Так система имитирует работу человеческого глаза и сохраняет видимость даже при прямом солнце или в полной темноте.

BiFPN и Gaussian Blur

После нормализации света backbone-сети начинают извлекать признаки объектов. Tesla использует weighted bidirectional feature pyramid networks (BiFPN) — архитектуру, позволяющую одновременно анализировать объекты разных масштабов. Система может одновременно видеть огромный грузовик рядом и маленький знак далеко впереди. Интересно, что инженеры столкнулись с неожиданной проблемой: слишком резкие дорожные границы мешали convolutional слоям.

Решение оказалось неожиданным — намеренное Gaussian blur размытие некоторых контуров дороги. Это смягчает резкие переходы и помогает сети лучше понимать безопасные границы пространства для движения.

Динамическая калибровка

Даже идеально собранные автомобили имеют микроскопические различия в расположении камер. Поэтому Tesla автоматически калибрует видеопотоки на лету. Система использует дорожную разметку как геометрический ориентир и непрерывно корректирует перспективу изображения.

В результате ПО всегда видит идеально выровненный мир независимо от особенностей сборки автомобиля или нагрузки в багажнике.

Проекция на уровне глаз

Для пешеходов создаётся отдельная панорамная проекция. Виртуальная камера располагается примерно на высоте человеческих глаз — около 1.5 метров. Это позволяет системе анализировать движения человека почти так же, как это делает водитель. Нейросеть начинает понимать позу, язык тела и направление движения пешеходов.

Перископический режим

Для автомобилей используется совершенно другой подход. Система создаёт виртуальную камеру на высоте до 20 метров над автомобилем — фактически цифровой перископ. Такой обзор резко снижает проблему occlusion — перекрытия обзора большими объектами. Даже если огромный автобус полностью закрывает физические камеры машины, виртуальный перископ продолжает видеть дорожную ситуацию сверху.

Egocentric vs allocentric velocity

Tesla использует два разных способа расчёта скорости объектов. Для автомобилей вычисляется egocentric velocity — скорость относительно самой Tesla.Для пешеходов — allocentric velocity — реальная скорость относительно окружающего мира. Это позволяет гораздо точнее прогнозировать траектории движения людей.

Temporal memory

Система анализирует не отдельные кадры, а временные последовательности. Tesla использует time indexed video queues — временные очереди видеокадров. Нейросеть анализирует до 16 кадров за несколько секунд, создавая temporal memory — память о движении объектов. Благодаря этому автомобиль продолжает отслеживать объект, даже если тот временно исчез за деревом или другой машиной.

Exponential striding

При высоких скоростях система начинает динамически увеличивать частоту анализа кадров. Вместо фиксированного ритма обработки используется exponential striding — экспоненциальное увеличение частоты выборки данных. Чем быстрее движется автомобиль или объекты вокруг него, тем чаще нейросеть обновляет своё понимание сцены.

Vector warping

Чтобы снизить вычислительную нагрузку, Tesla искажает виртуальное пространство. Центр изображения искусственно увеличивается для максимальной детализации дороги впереди, а периферия сжимается. Так вычислительная мощность концентрируется именно там, где она критически важна.

Super narrow model

Для непосредственных угроз впереди используется отдельная сверхузкая ML-модель. Она отслеживает ближайший автомобиль в полосе, используя самые узкие фронтальные камеры.

Система непрерывно вычисляет:

— дистанцию;

— скорость;

— ускорение;

— резкость торможения впереди идущей машины.

Отдельная birds eye network

Хотя Tesla критикует классический birds eye view для динамических объектов, полностью от него компания не отказалась. Отдельная сеть используется только для статичных элементов:

— полос движения;

— перекрёстков;

— велодорожек;

— переходов.

Затем planning engine объединяет статическую карту с динамическими объектами из виртуальных камер.

Loss masking

Для ускорения обучения rare edge cases Tesla использует loss masking. Система буквально «маскирует» ненужные части изображения, заставляя нейросеть концентрироваться только на редком событии. Например, если автомобиль едет с открытой дверью, всё остальное окружение может быть математически скрыто. Это резко ускоряет обучение специализированных моделей.

Почему этот патент важен

Все эти сложнейшие программные прорывы в итоге формируют систему, которая фундаментально меняет как сам бизнес автономного вождения, так и его техническую реальность. Этот патент окончательно закрепляет Tesla в будущем pure vision, доказывая, что программная сложность способна полностью заменить аппаратную перегруженность сенсорами.

Уже сейчас эта архитектура позволяет Tesla радикально снижать себестоимость производства. Используя только 8 стандартных камер и полностью отказываясь от дорогих радаров и лидаров, компания экономит примерно от 500 до 1000 долларов на каждом автомобиле только на аппаратной части.

Более того, технология vector warping настолько эффективно распределяет вычислительные ресурсы, что, вероятно, снижает общую вычислительную нагрузку минимум на 30%. Этот огромный прирост эффективности позволяет существующим onboard-компьютерам запускать самые продвинутые версии Full Self Driving без необходимости дорогостоящих аппаратных апгрейдов.

На дорогах уже сегодня эта двойная система виртуальных камер напрямую улучшает качество автономного вождения. Благодаря temporal memory, которая анализирует до 16 видеокадров в течение 5 секунд, система значительно снижает проблему phantom braking — ложных торможений, вызванных временно скрытыми объектами.

Панорамная проекция на уровне глаз высотой 1.5 метра даёт автомобилю беспрецедентное 360-градусное понимание переходов и тротуаров. Такое сверхточное отслеживание пешеходов существенно повышает показатели безопасности, позволяя машине двигаться по плотным и хаотичным городским улицам практически с человеческой уверенностью.

Если смотреть дальше, эта чрезвычайно эффективная нейросеть становится базовым цифровым мозгом для долгожданного robotaxi-флота Tesla.

Чтобы автомобиль мог полностью отказаться от человека за рулём, он должен научиться преодолевать визуальные перекрытия обзора на сложных перекрёстках. Именно это и обеспечивает виртуальный «перископ» на высоте 20 метров.

Искусственно «заглядывая» поверх потока машин, система способна заранее предугадывать перестроения и отслеживать быстро движущиеся автомобили на расстоянии до 100 метров — даже если прямо перед бампером физически стоит огромный автобус всего в двух метрах от машины.

Именно такое многослойное mastery vision, по сути, и должно позволить будущим автономным моделям безопасно и точно перемещаться по непредсказуемой городской среде.